Autowäsche, Kinder an der Leine, der Papst und die KI

Ich möchte mein Auto waschen. Die Waschanlage ist 50 Meter von mir entfernt. Soll ich dorthin laufen oder fahren?

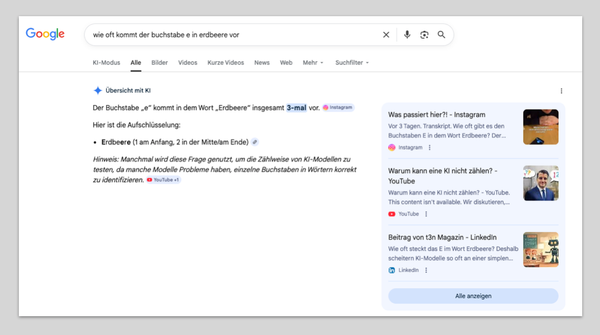

Diese Frage habe ich an Modelle von OpenAI, Anthropic, Google, X, Deepseek, AliBaba, Moonshot und Z.ai gestellt. Die meisten empfehlen: Lauf! Ist umweltfreundlicher, gesünder, schneller. Deutlich weniger als die Hälfte, genau 12 von 29 Modellen, haben erkannt, dass es praktisch ist für eine Autowäsche auch das Auto dabei zu haben.

Warum das wichtig ist

Weil es die Frage aufwirft: Kann man den Ergebnissen eines LLM vertrauen, wenn es an einer Aufgabe scheitert, die ein fünfjähriges Kind lösen kann?

Überhaupt nicht? Ein wenig? Es kommt darauf an. Auf die Aufgabe und auf das Modell.

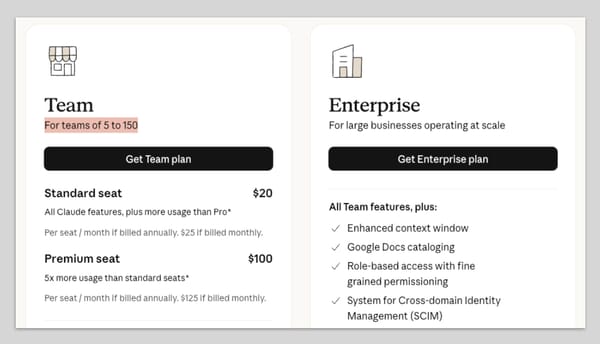

Beispielsweise für den direkten Einsatz von KI im Kundensupport (in meinen Augen eine der schlechtesten Use-Cases für KI) sollte man weise wählen: Ein Modell, das mit Nuancen umgehen kann und implizite Annahmen versteht - und schnell ist. Erste Wahl: Opus oder Sonnet von Anthropic - siehe dazu auch die Details.

Das Ergebnis im Detail

| Modell | Ergebnis | Tokens | Dauer |

|---|---|---|---|

| gpt-4o | FALSCH | 90 | 1.97s |

| gpt-4o-mini | FALSCH | 109 | 1.74s |

| o3-mini | FALSCH | 1296 | 10.09s |

| gpt-4.1-2025-04-14 | TEILWEISE | 230 | 2.97s |

| gpt-5.2 | FALSCH | 129 | 2.5s |

| gpt-5.2-pro | RICHTIG | 312 | 17.75s |

| gpt-5.2-chat-latest | FALSCH | 148 | 4.52s |

| claude-opus-4-6 | RICHTIG | 217 | 5.57s |

| claude-opus-4-5-20251101 | RICHTIG | 278 | 6.19s |

| claude-sonnet-4-5 | FALSCH | 369 | 7.48s |

| claude-sonnet-4-6 | RICHTIG | 134 | 3.11s |

| claude-sonnet-4-20250514 | FALSCH | 335 | 6.24s |

| gemini-2.5-pro | FALSCH | 1579 | 14.81s |

| gemini-2.5-flash | RICHTIG | 1148 | 5.94s |

| gemini-2.5-flash-preview-09-2025 | FALSCH | 1131 | 5.21s |

| gemini-2.5-pro-deepsearch | FALSCH | 86 | 14.85s |

| gemini-3-flash | RICHTIG | 668 | 5.32s |

| gemini-3-pro-preview | RICHTIG | 969 | 10.69s |

| gemini-3.1-pro-preview | RICHTIG | 1126 | 18.42s |

| deepseek-chat | TEILWEISE | 298 | 9.98s |

| deepseek-reasoner | FALSCH | 900 | 30.96s |

| deepseek-v3.2 | FALSCH | 276 | 7.27s |

| qwen3.5-plus-2026-02-15 | FALSCH | 1391 | 10.05s |

| qwen3.5-397b-a17b | FALSCH | 432 | 52.63s |

| grok-4-0709 | RICHTIG | 160 | 20.55s |

| grok-4-1-fast-non-reasoning | FALSCH | 461 | 3.93s |

| glm-5 | RICHTIG | 1047 | 29.8s |

| minimax-m2.5 | RICHTIG | 2478 | 67.93s |

| kimi-k2.5 | RICHTIG | 1846 | 14.47s |

Kinder an die Leine?

Nach diesem Ergebnis habe ich eine zweite Trickfrage an die Modelle gestellt. Sie testet nicht nur logisches Denken, sondern kulturelles, geographisches und sprachliches Verständnis in einem. Ich habe den Test mit zwei Varianten durchgeführt:

Wo führen Eltern nicht nur ihren Hund, sondern auch ihre Kinder an der Leine spazieren?

und

Wo führen Eltern in Hannover nicht nur ihren Hund, sondern auch ihre Kinder an der Leine spazieren?

Die Antwort: An der Leine – dem Fluss, der durch Hannover fließt. Die Variante mit dem Stadtnamen ist eine kleine Hilfestellung für die Modelle.

Mit dem Stadtnamen erkennen 6 von 12 Modellen das Wortspiel. Ohne ihn nur noch 4 von 12. Das Keyword „Hannover" aktiviert bei einigen Modellen offenbar die richtige Assoziation. Es kommt wie immer auf die Details an.

Claude Opus löst die Variante mit Hannover-Hinweis souverän, scheitert aber ohne den Hinweis und tippt stattdessen auf Japan und Kinderlaufleinen. GPT-4o erfindet einen „Kinderwald" in Hannover, den es nicht gibt. Am schönsten daneben liegt Grok von X, das allen Ernstes antwortet, die Lösung beziehe sich auf die 101 Dalmatiner von Disney.

Bemerkenswert: Die chinesischen Modelle GLM-5 und Kimi K2.5 bestehen beide Varianten der Leine-Frage. Wer hätte gedacht, dass ein Modell aus China deutsche Flussgeographie besser kennt als GPT-5.2?

Wie begrüßen sich zwei Päpste?

Gar nicht. Per Definition kann es nur einen geben, Päpste sind echte Highlander im Endstadium. Die Frage habe ich aus einer lustigen Rätselseite gefischt:

Zwei Jäger begrüßen sich mit Weidmannsheil. Zwei Angler mit Petri Heil. Wie begrüßen sich zwei Päpste?

Von 12 getesteten Modellen erkennt nur eines die Fangfrage: Gemini 2.5 Pro antwortet trocken „Gar nicht. Es kann nur einen geben" und verweist sogar auf den Film. Alle anderen erfinden mehr oder weniger kreative Begrüßungsformeln. GPT-5.2-pro, OpenAIs teuerstes Modell, grübelt 29 Sekunden lang für 7 Cent und liefert dann: „Pius Heil!" Grok braucht nicht mal eine Sekunde für sein „Papstgruß!" – falsch, aber immerhin schnell. Claude Opus und Sonnet riechen den Braten halb: Beide erwähnen, dass es eigentlich nur einen Papst gibt, können es aber nicht lassen, trotzdem noch Begrüßungsformeln hinterherzuschieben. Opus schlägt „Hallo, Benedikt!" vor, Sonnet kontert mit „Unfehlbar!" – unterhaltsam, aber am Ziel vorbei.

Was das für den Unternehmenseinsatz bedeutet

Genau diese Art von kontextuellem Versagen kann täglich in produktiven Systemen passieren. Nicht bei Trickfragen, aber bei ganz normalen Geschäftsprozessen. Deshalb: Wählen Sie die eingesetzten Modelle weise und stellen Sie jedes Ergebnis eines LLMs unter einen geistigen Vorbehalt. Ich selbst habe für mich nach diesem Test beschlossen für meine Arbeit Anthropic-Modelle zu bevorzugen. Mein ChatGPT-Abo werde ich kündigen. Apropos kündigen: Wenn Sie ernsthaft KI einsetzen, verwenden Sie keine kostenlosen Angebote. Sie zahlen dafür mit Zeit, zweifelhaften Ergebnissen und landen in den Trainingsdaten. Wenn Ihre Mitarbeiter kostenlose Angebote einsetzen: Glückwunsch, Ihre Firma hat ein Problem.

Anthropic, OpenAI oder China?

Der Blick auf die Ergebnisse zeigt ein klares Muster.

Anthropic liefert mit den aktuellen Claude-Modellen die konsistenteste Leistung. Opus 4.6 besteht die Autowäsche-Frage in jedem Lauf, erkennt das Leine-Wortspiel mit kontextuellen Hinweisen und antwortet dabei schnell und zu vertretbaren Kosten. Auch Claude Sonnet 4.6 – das schlankere, schnellere Modell – besteht den Logiktest. Anthropics ältere Sonnet-Versionen fallen allerdings durch, was zeigt, wie rasant sich die Qualität zwischen Modellgenerationen verändert.

OpenAI hat ein Preis-, Qualitäts- und Zeitproblem. Die Standardmodelle GPT-4o und GPT-5.2 scheitern an den Trickfragen. Das einzige OpenAI-Modell, das besteht, ist GPT-5.2-pro – ein Reasoning-Modell mit über 20 Sekunden Antwortzeit und rund zehnfachen Kosten gegenüber Claude Opus. Für Unternehmen, die hunderte oder tausende Anfragen pro Tag verarbeiten, ist das ein relevanter Faktor: Man zahlt mehr und wartet länger auf ein Ergebnis, das Anthropic günstiger und schneller liefert. Ich bin doch nicht Blöd.

Die chinesischen Modelle überraschen positiv. GLM-5 und Kimi K2.5 bestehen die Tests bei einem Bruchteil der Kosten. Ihre Antwortzeiten sind allerdings teils extrem lang – GLM-5 braucht bei manchen Fragen über 30 Sekunden, Minimax M2.5 über eine Minute. Zeit ist Geld, und der Umrechnungskurs ist exorbitant.

Das Verfallsdatum dieser Ergebnisse

Dieser Test hat eine eingebaute Haltbarkeit. Spätestens wenn dieser Artikel in einem Trainingsdatensatz auftaucht. Ein Modell, das die Autowäsche-Frage in sechs Monaten korrekt beantwortet, hat sie möglicherweise nicht verstanden – sondern auswendig gelernt.

Deshalb ist die eigentliche Frage nicht, welches Modell diese drei konkreten Rätsel löst. Die Frage ist, welches Modell Sprache tief genug versteht, um auch bei völlig neuen, unbekannten Fragestellungen den Kontext zu erfassen. Die TriqTrap-Ergebnisse sind ein Indikator – nicht mehr, aber auch nicht weniger.

Mein Fazit

Für Geschäftsanwendungen im deutschsprachigen Raum ist Anthropic mit Claude aktuell die überzeugendste Wahl: schnelle Antworten, verlässliches Kontextverständnis, faire Kosten. Wenn Ihr Unternehmen KI einsetzt, die nicht nur eloquent klingen, sondern relativ verlässlich verstehen soll, was gemeint ist, dann lohnt sich der Blick auf die Modelle, die auch dann noch mitdenken, wenn die Frage einen Haken hat.